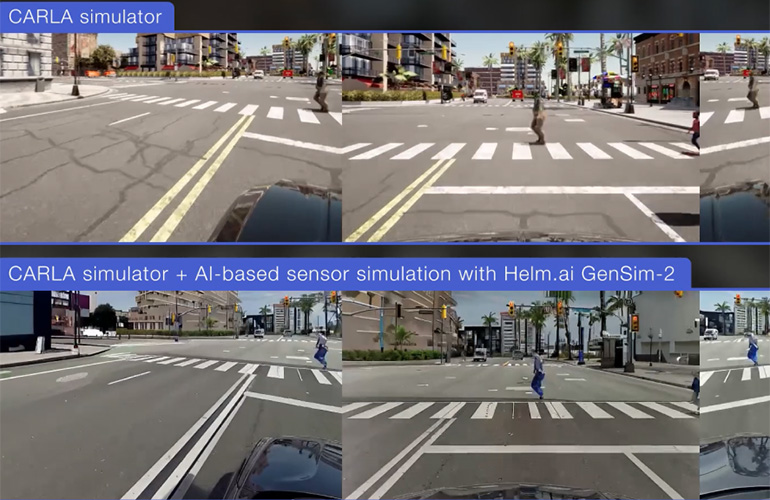

Com o Gensim-2, os desenvolvedores podem modificar condições climáticas e de iluminação, como chuva, neblina, neve, brilho e hora do dia ou da noite em dados de vídeo. | Fonte: Helm.ai

A Helm.Ai apresentou na semana passada o Helm.ai Driver, uma rede neural profunda em tempo real, ou DNN, sistema de prescrição de caminho baseado em transformadores para a condução autônoma de rodovias e nível 4 urbano. A empresa demonstrou os recursos do modelo em um ambiente de circuito fechado usando seu modelo proprietário de fundação generativa de Gensim-2 para renderizar dados realistas do sensor em simulação.

“Estamos empolgados em mostrar a previsão de caminho em tempo real para dirigir urbano com o motorista do Helm.ai, com base em nossa arquitetura DNN de transformador proprietário que requer apenas a percepção baseada na visão como entrada”, afirmou Vladislav Voroninski, CEO e fundador da Helm.ai. “Ao treinar dados do mundo real, desenvolvemos um sistema avançado de predição de caminho que imita os comportamentos sofisticados dos motoristas humanos, a aprendizagem de ponta a ponta sem nenhuma regra explicitamente definida”.

“É importante ressaltar que nossa previsão de caminho urbano para (SAE) L2 a L4 é compatível com a nossa pilha de percepção de visão de visão de produção de produção “, continuou ele.

Fundada em 2016, a Helm.Ai desenvolve software de inteligência artificial para sistemas avançados de assistência ao motorista (ADAS), veículos autônomos e robótica. A empresa oferece sistemas de IA em tempo real, incluindo sistemas autônomos de ponta a ponta, além de ferramentas de desenvolvimento e validação alimentadas por sua profunda metodologia de ensino e IA generativa.

A Helm.ai, com sede em Redwood City, Califórnia, colabora com montadoras globais em projetos ligados à produção. Em dezembro, revelou o Gensim-2, seu modelo generativo de IA para criar e modificar dados de vídeo para direção autônoma.

Helm.ai Driver aprende em tempo real

https://www.youtube.com/watch?v=JMZGBK45GXQ

Helm.ai disse que é o novo modelo prevê o caminho de um veículo autônomo em tempo real, usando apenas a percepção baseada em câmera-não é necessário mapas HD, lidar ou sensores adicionais. Ele leva a saída da pilha de percepção do grau de produção da Hel.AI como entrada, tornando-a diretamente compatível com o software altamente validado. Esta arquitetura modular permite validação eficiente e maior interpretabilidade, disse a empresa

Treinado em dados em larga escala e no mundo real usando a metodologia de ensino profunda proprietária da Helm.ai, o modelo de prescrição de caminho exibe comportamentos robustos e humanos em forma de motorista em cenários complexos de direção urbana, afirmou a empresa. Isso inclui lidar com cruzamentos, curvas, evitar obstáculos, manobras de passagem e resposta a cortes de veículos. Esses são comportamentos emergentes do aprendizado de ponta a ponta, não explicitamente programados ou sintonizados no sistema, observou Helm.ai.

Para demonstrar os recursos de credição de caminho do modelo em um ambiente dinâmico e realista, a Helm.ai o implantou em uma simulação de malha fechada usando a plataforma Carla de código aberto (consulte o vídeo acima). Nesse cenário, o Helm.ai Driver respondeu continuamente ao seu ambiente, assim como dirigir no mundo real.

Além disso, a Helm.ai disse que o Gensim-2 renderizou as cenas simuladas para produzir saídas de câmera realistas que se assemelham aos visuais do mundo real.

A Helm.ai disse que seus modelos de fundação para previsão de caminhos e simulação generativa de sensores “são os principais blocos de construção de sua abordagem da AI-primeiro à direção autônoma. A empresa planeja continuar entregando modelos que generalizam em plataformas de veículos, geografias e condições de condução.

Registre -se agora para não perder!